Paradigmenwechsel in der IT: KI folgt demselben Muster wie Agile, Microservices und Cloud

Jedes Mal, wenn sich der Softwareentwicklungsprozess grundlegend verändert hat, war es ein Versuch, Komplexität und Risiko beherrschbarer zu machen. Von Agile über Microservices bis Cloud verfolgten alle Wechsel dasselbe Ziel: schneller Software bauen, um Chancen zu nutzen und der Konkurrenz einen Schritt voraus zu sein. Doch keiner dieser Wechsel hat die Komplexität beseitigt – sie wurde lediglich an andere Stellen des Software-Lebenszyklus verschoben.

Wer das zugrunde liegende Muster versteht, kann das richtige Werkzeug für den jeweiligen Kontext wählen. Wer es nicht versteht, übernimmt am Ende Technologien, die nicht zum eigenen Betriebsmodell passen.

Genau deshalb sind manche Unternehmen besser aufgestellt, um vom AI Engineering zu profitieren, während andere trotz hoher Investitionen enttäuschende Ergebnisse erleben. Der KI-Paradigmenwechsel folgt demselben Muster.

Vier Paradigmenwechsel, ein wiederkehrendes Muster

Die IT hat über die Jahre mindestens drei grundlegende Wechsel erlebt. Mit KI erleben wir nun den vierten. Jeder davon betrifft eine andere Ebene: wie wir die Arbeit der Softwareentwicklung organisieren, wie wir Software strukturieren, wo wir sie betreiben und wie wir tatsächlich Code schreiben.

Vom Wasserfall zu Agile: Wie wir Softwareentwicklung organisieren

Der Wechsel vom Wasserfallmodell zu Agile war der erste große Paradigmenwechsel in der IT. Wasserfall basiert auf umfassender Vorabplanung. Späte Änderungen entwerten ganze Phasen und werden dadurch extrem teuer. Eine agile Vorgehensweise baut auf einer wichtigen Erkenntnis auf: Wir können zwar nicht vorhersagen, welche Änderungen kommen, aber die Organisation lässt sich so aufstellen, dass sie Veränderungen effizient absorbiert, wenn sie auftreten. Die Kosten von Änderungen sinken, ihre Häufigkeit steigt.

Unternehmen, die diese Dynamik verstehen und die entsprechenden Kapazitäten aufbauen, können sich besser an Veränderungen anpassen. Unternehmen, die Agile nur als Zeremonie der Softwareentwicklung einführen, ohne ihre Organisation und Kultur anzupassen, erleben mehr Chaos statt weniger Risiko.

Vom Monolithen zu Microservices: Wie wir Software strukturieren

Monolithische Architekturen bündeln alles in einem effizienten, aber unflexiblen Deployment. Microservices versprechen Unabhängigkeit – mit individuell deploybaren Einheiten, einem kleineren Blast Radius und schnelleren Änderungen, die den agilen Ansatz ergänzen. Doch sie verlagern Komplexität aus der Codebasis in die Koordination zwischen Teams und in die organisatorischen Strukturen, die für den Betrieb verteilter Systeme nötig sind.

Wer echte Service-Unabhängigkeit, eigenständige Teams und definierte APIs schafft, kann von einem deutlichen Geschwindigkeitsgewinn profitieren. Wer Microservices nur architektonisch einführt, ohne die organisatorische Struktur anzupassen, endet mit verteilter Komplexität, die deutlich schwerer zu kontrollieren ist als ein Monolith.

Von On-Premises zur Cloud: Wie wir Infrastruktur betreiben

Der Wechsel von On-Premises-Rechenzentren in die Cloud folgt derselben Logik. On-Premises bedeutet volle Kontrolle über die Hardware-Ressourcen, allerdings zu hohen Vorabinvestitionen. Die Cloud senkt die Einstiegshürde radikal, vergrößert aber gleichzeitig die Verwaltungsfläche erheblich. Statt Hardware zu managen, müssen Unternehmen jetzt Cloud-Konfigurationen, Zugriffsrechte und Kostenmodelle über Dutzende von Anbietern und Services hinweg beherrschen. Die Infrastruktur lässt sich einfacher bereitstellen und verändern – was Microservices und den agilen Ansatz ergänzt –, doch Governance wird deutlich anspruchsvoller.

Gleichzeitig entsteht ein Konzentrationsrisiko: Wer alles zu einem einzigen Cloud-Anbieter verlagert, macht sich von diesem einen Anbieter abhängig. Ein Risiko, das viele Unternehmen erst nach ihrem ersten größeren Ausfall ernst nehmen.

Von manueller Programmierung zu KI: Wie wir Code schreiben

Der vierte Paradigmenwechsel betrifft die Art, wie Software geschrieben wird. KI-gestützte Softwareentwicklung senkt die Kosten für das Schreiben von Code radikal. Während das Generieren von Code billig wird, bleibt das Verstehen, Bewerten und Einbetten von Code in eine bestehende Architektur teuer.

Unternehmen, die KI als reines Generierungswerkzeug einsetzen, laufen Gefahr, in dieselbe Falle zu tappen wie Unternehmen in jedem vorherigen Paradigmenwechsel.

- •Agile machte es leicht, Änderungen einzuführen, also hörten Unternehmen auf, Projekte zu planen, und verließen sich stattdessen auf agile Methoden, um alle auftretenden Änderungen zu absorbieren.

- •Microservices machten es leicht, neue Teams und Services zu schaffen, also hörten Unternehmen auf, ihre Systeme bewusst zu architekturieren, und verließen sich stattdessen darauf, Microservices nach Bedarf zu erzeugen und wieder abzubauen, wann immer sich die Umstände änderten.

- •Cloud machte es leicht, Hardware bereitzustellen, also hörten Unternehmen auf, ihren Ressourcenbedarf zu planen, und ließen ihre Systeme stattdessen unkontrolliert in der Cloud wachsen.

Wenn ein Engpass verschwindet, legt das oft den nächsten frei – und wenn schwere Dinge billig werden, ist die Versuchung groß, es damit zu übertreiben. AI Engineering macht das Generieren von Code einfach und verleitet uns dazu zu vergessen, wie schwierig es ist, Software über ihren gesamten Lebenszyklus hinweg zu betreiben und zu warten. Der Erfolg hängt davon ab, ob Unternehmen die Software, die sie produzieren, bewusst entwerfen und validieren – und ob sie ihre Qualitätsstandards halten, wenn die Menge an erzeugtem Code sie unter Druck setzt.

Das gemeinsame Muster: Komplexität verschwindet nicht, sie verschiebt sich

Alle vier Paradigmenwechsel zeigen dasselbe Muster: Richtig eingesetzt, machen sie Komplexität beherrschbar. Aber sie eliminieren sie nicht. Wer einen Paradigmenwechsel angeht, ohne den eigenen Kontext zu berücksichtigen, verschiebt Komplexität lediglich – von der Planung in den Betrieb, von konzentrierten zu verteilten Risiken, von hohen Einstiegshürden zu hoher operativer Komplexität.

Niedrigere Einstiegshürden, höhere operative Komplexität

Agile macht den Einstieg in die Entwicklung schneller, erfordert aber mehr Disziplin im laufenden Betrieb. Cloud beseitigt Hardware-Kosten, verlangt aber FinOps und starke Governance-Modelle. KI generiert Code in Sekunden, doch es braucht Expertise, um die Qualität dieses Codes zu bewerten. Die IT-Transformation verschiebt die Herausforderung konsequent von „Wie kommen wir ins Tun?" zu „Wie behalten wir die Kontrolle?"

Warum jeder Wandel Gewinner und Verlierer hervorbringt

Das Muster belohnt Unternehmen, die es verstehen, und bestraft jene, die es ignorieren. Gewinner nutzen es systematisch: Sie senken Einstiegskosten, iterieren schnell, machen Fehler billig – und bauen gleichzeitig die Fähigkeiten auf, um die neue operative Komplexität zu beherrschen.

Doch es gibt ein Risiko: Wer den Einsatz dieser Methoden nicht bewusst bewertet, kann die Häufigkeit von Fehlern mit gravierenden Folgen verstärken. Agile ohne Struktur und ohne Mechanismus zur Steuerung von Veränderungen, Microservices ohne Plattform-Team und klar definierte Schnittstellen, Cloud ohne FinOps – all das führt nicht zu Innovation, sondern zum Kontrollverlust.

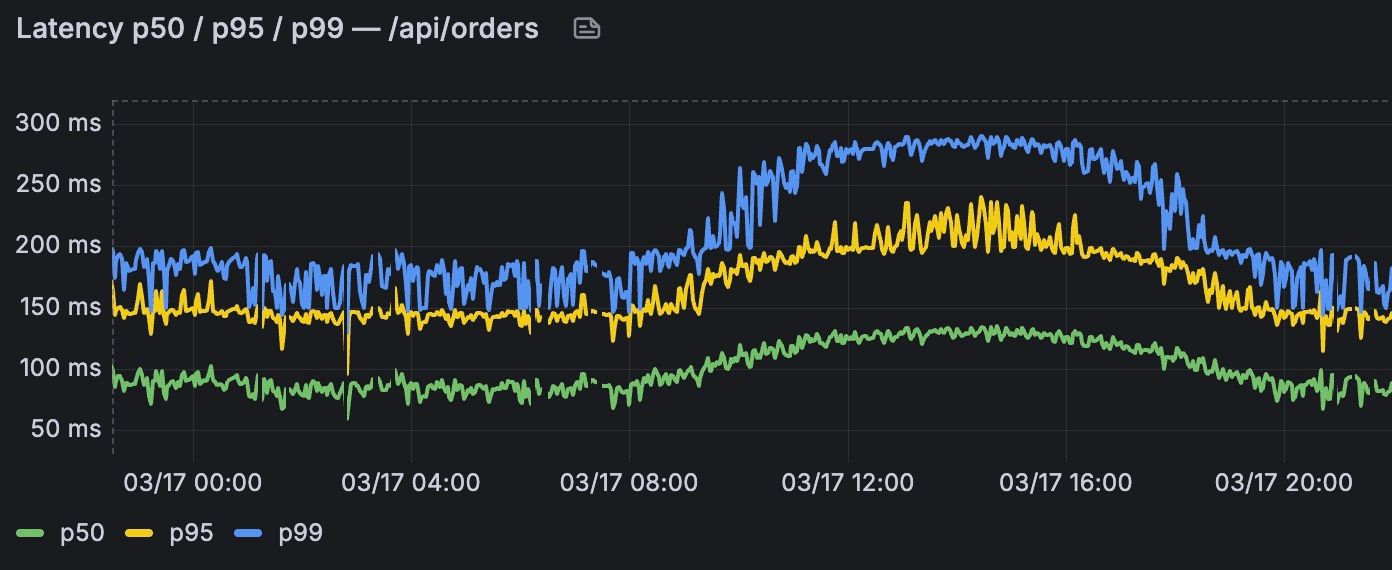

Von Fehlervermeidung zu Fehlererkennung

Der grundlegende Wandel in der KI-gestützten Softwareentwicklung betrifft die Engineering-Produktivität. Klassische Entwicklung investiert massiv in Fehlervermeidung – durch Code Reviews, Architekturentscheidungen und erfahrene Engineers, die einen großen Teil ihrer Produktivität darauf verwenden sicherzustellen, dass Fehler nur selten auftreten. KI-gestützte Entwicklung produziert Code zu schnell, als dass dieses Modell noch funktionieren würde. Beim Einsatz KI-gestützter Softwareentwicklung müssen Teams auf Fehlererkennung statt auf Fehlervermeidung setzen, damit schnell generierter Code validiert und bei Bedarf verworfen oder überarbeitet werden kann.

Das ist kein Qualitätsverlust, sondern ein anderes Qualitätsmodell. Es erfordert andere Fähigkeiten, andere Prozesse und andere Werkzeuge. Unternehmen, die ihre bestehenden Quality Gates einfach beibehalten, werden feststellen, dass diese nicht zum neuen Modell passen. Wer diesen Wandel bewusst gestaltet, kann beide Modelle kombinieren.

Die Geschwindigkeit der Veränderung als Risiko an sich

Die Geschwindigkeit der Adoption ist ein Aspekt, der den KI-Paradigmenwechsel klar von seinen Vorgängern unterscheidet. Die Einführung von Agile hat ein Jahrzehnt gedauert, Cloud-Migrationen ziehen sich über Jahre. KI-Werkzeuge verbreiten sich innerhalb von Monaten.

Diese Geschwindigkeit bedeutet, dass Unternehmen weniger Zeit haben, aus Fehlern zu lernen. Die Konsequenzen schlecht gewählter Strategien werden schneller sichtbar. Und wenn die Einführung von KI nicht geordnet gesteuert wird, wächst Schatten-IT. Teams nutzen Werkzeuge auf eigene Faust – ohne Governance, ohne architektonische Abstimmung und ohne Qualitätssicherung.

Was das für technische Entscheidungen bedeutet

Diese vier Methoden sind keine voneinander unabhängigen Entscheidungen. Wer sich für Microservices entscheidet, braucht Cloud oder zumindest eine verteilte Infrastruktur. Wer Cloud nutzt, braucht DevOps-Fähigkeiten, die typischerweise in einem agilen Kontext entstehen. Wer KI einführt, muss entscheiden, ob schnelle Code-Generierung zur bestehenden Architektur und Infrastruktur passt.

Agile, Cloud und Microservices sind miteinander verbunden, aber das heißt nicht, dass alle Hebel gleichzeitig gezogen werden müssen. Eine bewusste Wahl eines Hebels hat Konsequenzen für die anderen, und ein Unternehmen muss diese Konsequenzen verstehen, bevor Transformationsprojekte starten.

Risikotoleranz als strategischer Kompass

Der wichtigste Schritt ist es, die eigene Risikotoleranz explizit zu definieren – als konkrete Entscheidungsgrundlage: Wie viel Unsicherheit kann Ihre Organisation absorbieren? Wie schnell können Sie auf unerwartete Ereignisse reagieren? Welche Fehler sind akzeptabel und welche existenziell?

Diese Fragen bestimmen, welche Kombination der vier Hebel für Ihr Unternehmen die richtige ist. Unserer Erfahrung nach scheitern IT-Transformationen selten an der Technologie. Sie scheitern am fehlenden Fit zwischen dem gewählten Paradigma und der organisatorischen Realität.

Der richtige Mix der vier Hebel

Es gibt keine universell richtige Kombination. Ein Start-up mit drei Engineers braucht einen anderen Betriebsmodus als ein Konzern mit 500 Entwicklern. Aber beide profitieren davon, ihre Entscheidungen bewusst zu treffen – statt Trends zu folgen.

Fazit

Alle vier IT-Paradigmenwechsel – von Wasserfall zu Agile, vom Monolithen zu Microservices, von On-Premises zur Cloud und von manueller Entwicklung zu KI – folgen demselben Muster: Komplexität verschwindet nicht, sie verschiebt sich. Einstiegshürden sinken, operative Komplexität steigt, und der Erfolg hängt davon ab, ob Unternehmen diesen Wandel bewusst steuern.

Der KI-Paradigmenwechsel beschleunigt dieses Muster und gibt Unternehmen daher weniger Zeit, die richtige Strategie zu finden. Wer das Muster versteht, entscheidet bewusst. Wer es ignoriert, folgt Trends.

Ausblick: Die Risikoperspektive

Im nächsten Beitrag dieser Serie analysieren wir das Muster im Detail durch die Brille des Risikomanagements. Wir zeigen, warum jeder Paradigmenwechsel das Verhältnis zwischen Eintrittswahrscheinlichkeit und Auswirkung verschiebt und wie Sie den richtigen Betriebsmodus für Ihr Unternehmen wählen.